Adrian Pohl arbeitet seit 2008 im Hochschulbibliothekszentrum des Landes Nordrhein-Westfalen (hbz). Seit Juni 2010 ist er Koordinator der Arbeitsgruppe der Open Knowledge Foundation zu Open Bibliographic Data. Im Interview berichtet Pohl über die Zusammenarbeit mit anderen Aktiven aus Wissenschaft und Bibliothekswelt. Ihr Ziel: der Aufbau einer Infrastruktur für offene bibliographische Daten.

Herr Pohl, worum geht es bei Open Bibliographic Data (OBD)?

Adrian Pohl: Wir orientieren uns an der Open-Access-Bewegung. Deren Idee wird bereits weitgehend in der Bibliothekswelt unterstützt: Ergebnisse öffentlich finanzierter Wissenschaft sollen auch jedem öffentlich zugänglich sein. Bibliotheken sind ebenfalls meist aus öffentlichen Geldern finanziert. Deshalb sollten die von ihnen produzierten Daten auch offen zugänglich und wiederverwendbar sein. Mit den „Prinzipen zu offenen bibliographischen Daten“ haben wir in der Open Knowledge Foundation klare Anforderungen für die Freigabe solcher Daten formuliert, insbesondere im Hinblick auf die Wahl der Lizenz. Bibliotheksdaten können vielen von Nutzen sein.

Wofür zum Beispiel?

Pohl: Sammlungen bibliographischer Daten können als eine Landkarte verstanden werden, die uns Orientierung gibt in der Landschaft unserer literarischen, wissenschaftlichen oder künstlerischen Erzeugnisse.

So können die Daten etwa in der Forschung genutzt werden. Für Historiker beispielsweise könnte die Frage interessant sein, in welchem Jahrhundert zu bestimmten Zeiten wo wichtige Publikationsorte waren. Mit automatisierten Abfragen offener Daten aus Bibliothekskatalogen ließe sich zügig eine Übersicht über die meistgenutzten Publikationsstandorte erstellen. Das ginge weit über das hinaus, was mit normalen Rechercheoptionen möglich ist.

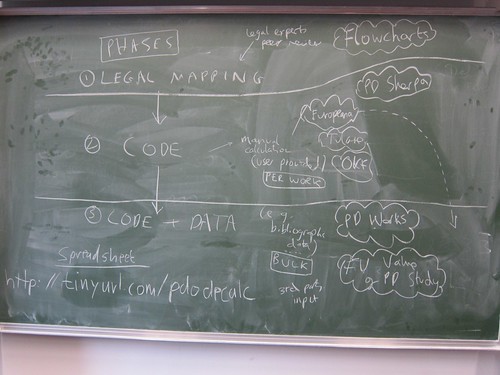

Ein anderes Beispiel: Bibliotheksdaten werden bereits für Anwendungen genutzt, die den urheberrechtlichen Status eines Werkes berechnen, ob es geschützt oder gemeinfrei ist. Mehr freie Daten könnten diese Dienste enorm verbessern. Es lassen sich unzählige weitere Anwendungen denken.