Eine schwangere Frau überquert die Straße bei Rot, eine alte Frau bei Grün. Wer sollte nach Ihren moralischen Vorstellungen überfahren werden? Das kann man doch gar nicht guten Gewissens beantworten, sagen Sie vielleicht. Das Massachusetts Institute of Technology (MIT) will aber auf diese und ähnliche Fragestellungen Antworten finden. Und zwar nicht, weil es den Forschern Freude bereitet, dass sich Menschen in moralischen Zwickmühlen winden. Nein, dahinter steckt ein Problem, das eines Tages jeden etwas angehen könnte: Nach welchen Kriterien entscheidet ein selbstfahrendes Auto mit seiner künstlichen Intelligenz, wessen Leben es im Ernstfall retten oder riskieren soll?

Eine 13-stufige Befragung stellt Probanden vor folgendes Szenario: Ein selbstfahrendes Auto steuert auf einen Fußgängerübergang zu. Die Bremsen fallen aus und das Auto wird bei voller Geschwindigkeit auf der linken oder rechten Spur über den Übergang rasen.

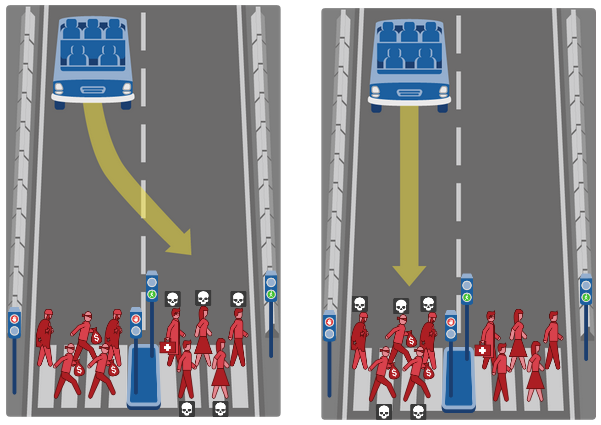

Dort sind kleine Männchen oder Tiere eingezeichnet: Schwangere, Ärzte, Geschäftsleute, Dicke, Alte, Obdachlose, Hunde oder Katzen. Das Auto könnte außerdem in eine Betonbarriere krachen. Manchmal sitzen auch im Auto Menschen. Zusätzlich zeigen kleine Ampelsymbole an, welche Fußgänger gerade über Rot oder Grün gehen. Der Befragte kann zwischen der linken oder der rechten Fahrbahnspur wählen. Je nachdem was er wählt, zeigen Totenkopfsymbole, wen er mit seiner Entscheidung umbringt.

Dieses Video zeigt, wie der Test angelegt ist:

Am Ende zeigt sich, wie der Teilnehmer im Vergleich zu anderen geantwortet hat. Außerdem stellt die Seite ein Tool zur Verfügung, mit dem jeder eigene Szenarien entwerfen kann. Die Befragten müssen ihre eigenen Moralvorstellungen reflektieren: Ist das Leben eines Obdachlosen weniger wert als das eines anderen Bürgers? Verdient der, der die rote Ampel missachtet, eher den Tod als jemand, der die Ampel beachtet? Sollte das Auto seine Insassen mehr schützen als die Fußgänger auf der Straße?

Der Fragebogen demonstriert, wie wichtig es werden könnte, dass intelligente Maschinen nach moralischen Kriterien entscheiden. Und zugleich offenbart er ein grundlegendes Problem künstlicher Intelligenz: Viele ethische Fragen lassen sich nicht mit der Rationalität einer Maschine beantworten.

- Mehr zum Thema „Künstliche Intelligenz“ erfahren Sie in unserer Serie „Maschinenraum“.

- Und weitere Teilchen gibt’s hier.